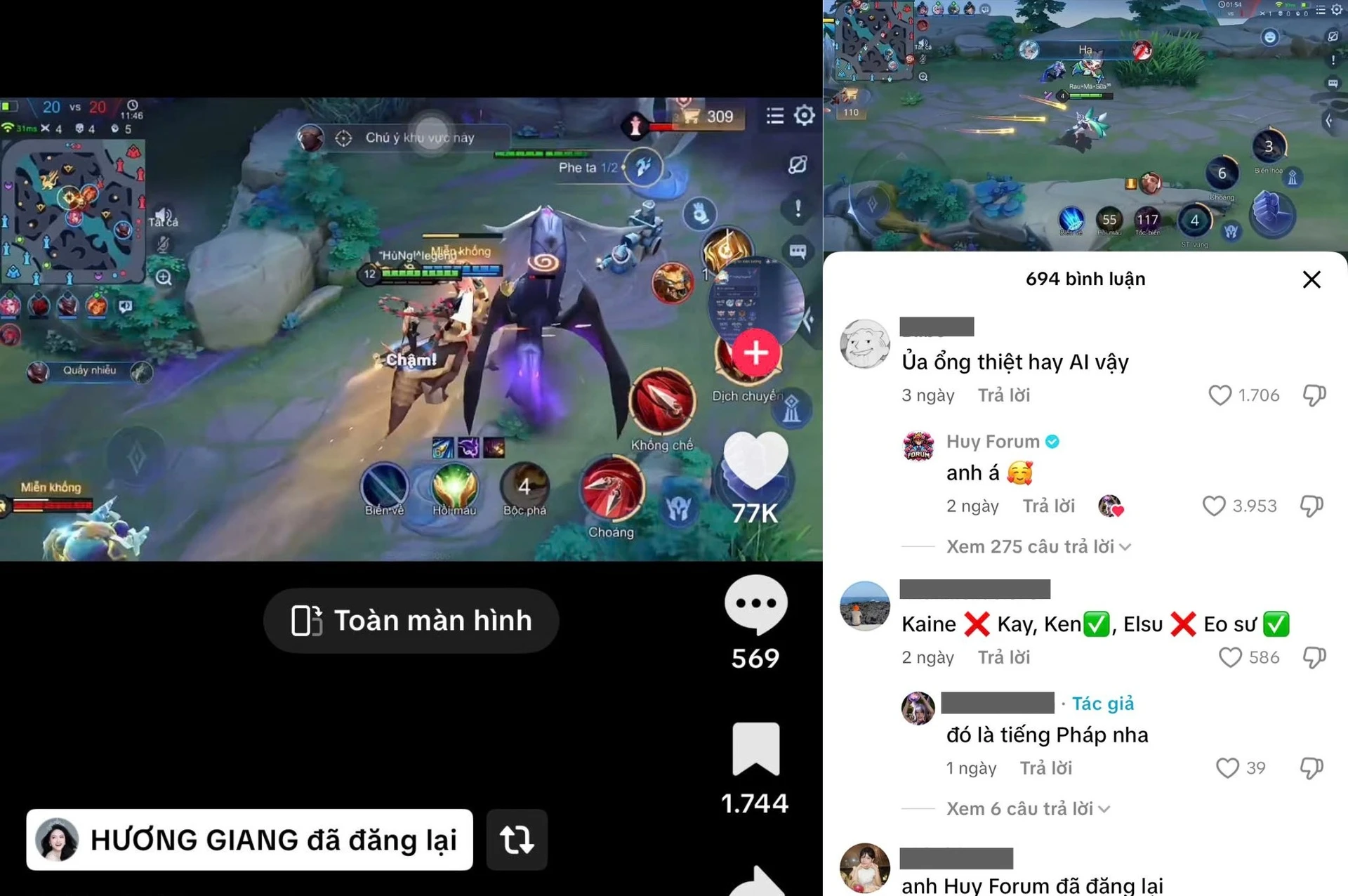

Chỉ cần lướt TikTok vài phút, không ít bạn trẻ sẽ bắt gặp clip game Liên Quân Mobile hay highlight thể thao với phần bình luận nghe quen thuộc. Giọng của Hương Giang, Phương Mỹ Chi, Bích Phương hay các TikToker đình đám như Huy Forum, Thơ Nguyễn, Jenny Huỳnh bỗng trở thành “bình luận viên ảo”.

Người xem vừa ngạc nhiên vừa thích thú, thậm chí còn để lại bình luận hài hước: “Giờ thì nghệ sĩ nào cũng chơi Liên Quân hết rồi!”. Nhiều chính chủ như Hương Giang hay Huy Forum cũng chia sẻ lại clip dùng giọng của mình, tỏ ra khá vui vẻ trước sự sáng tạo này.

Công nghệ đứng sau trào lưu giả giọng

Điểm mấu chốt nằm ở công cụ AI tên Minimax, xuất phát từ Trung Quốc và nổi tiếng với khả năng nhân bản giọng nói chỉ cần vài giây ghi âm. Nhờ đó, người dùng chỉ việc nhập đoạn văn bản cần đọc và chờ vài phút để có file audio với chất giọng “chuẩn sao Việt”.

Không chỉ Minimax, nhiều nền tảng khác như ElevenLabs hay OpenAI TTS cũng khiến việc tạo giọng ảo ngày càng dễ dàng. Chính sự tiện lợi này đã biến voice cloning thành xu hướng bùng nổ, nhất là trên TikTok nơi các clip ngắn dễ lan truyền mạnh mẽ.

Nếu chỉ dừng ở mức giải trí, đây rõ ràng là một ý tưởng sáng tạo và thú vị. Tuy nhiên, cùng lúc đó, không ít trường hợp đã cho thấy mặt trái của công nghệ này.

Tại Việt Nam, từng xuất hiện chiêu lừa đảo gọi điện cho phụ huynh, giả giọng con em gặp tai nạn để ép chuyển tiền khẩn cấp. Trên thế giới, có giám đốc ở Anh bị lừa hơn 240.000 USD và một nhân viên tài chính ở Hong Kong mất tới 3,3 triệu USD chỉ vì tin vào giọng “giả” của cấp trên.

Giữa sáng tạo và ranh giới nhạy cảm

Nhiều công ty AI đặt ra quy định “không dùng giọng người thật nếu chưa được phép”, nhưng thực tế rất khó kiểm soát. Công nghệ này tương tự deepfake thay gương mặt, chỉ khác ở chỗ là nhái lại giọng nói.

Không ít nghệ sĩ quốc tế như Drake hay The Weeknd từng lên tiếng bức xúc khi ca khúc “AI cover” dùng giọng họ lan truyền chóng mặt. Trong khi đó, các tranh cãi về quyền riêng tư, quảng cáo trái phép hay tin giả vẫn chưa có khung pháp lý rõ ràng để bảo vệ nghệ sĩ.

Dù gây tranh cãi, voice cloning vẫn có những giá trị nhân văn nếu ứng dụng đúng. Công nghệ này có thể tái hiện giọng người thân đã mất hoặc giúp bệnh nhân mất giọng tìm lại tiếng nói. Và quan trọng hơn, mỗi khi giọng nói cá nhân được sử dụng, việc thông báo và xin phép vẫn cần được đảm bảo để hạn chế rủi ro.